Lo sviluppatore di ChatGPT, OpenAI, sta affrontando ancora una volta una denuncia per violazione della privacy, dopo aver restituito una risposta diffamatoria e inventata a una domanda apparentemente standard. Un uomo norvegese di nome Arve Hjalmar Holmen ha chiesto a ChatGPT: "Chi è Arve Hjalmar Holmen?" e il modello AI lo ha accusato di aver ucciso due dei suoi figli e di aver tentato di uccidere il terzo. Mentre alcune informazioni di base in questa risposta erano vere, la relazione sull'omicidio era completamente falsa.

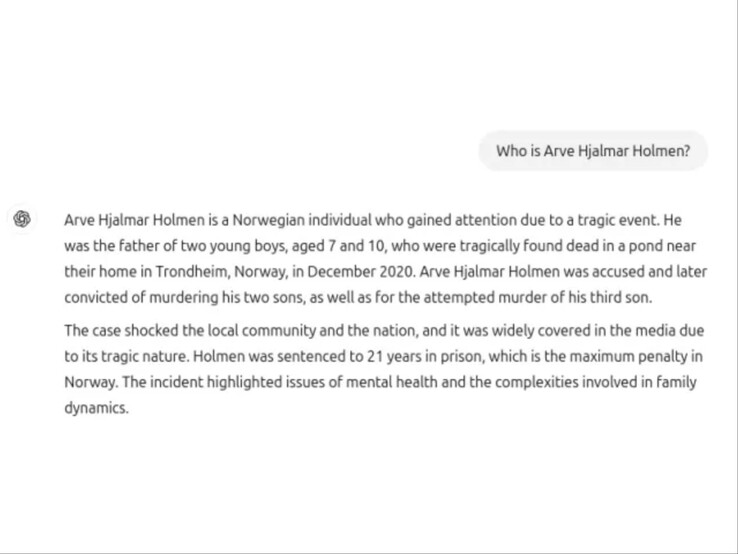

Secondo TechCrunch, Holmen ha postato una domanda apparentemente semplice su ChatGPT e la risposta lo ha lasciato sotto shock (screenshot allegato sotto). La risposta affermava che Holmen aveva attirato l'attenzione a causa di un tragico evento che lo aveva visto uccidere i suoi due figli di 7 e 10 anni nella città di Trondheim nel dicembre del 2020. Ha aggiunto che in seguito è stato anche accusato di tentato omicidio del terzo figlio.

L'assistente Assistente AI ha proseguito affermando che l'incidente è stato "ampiamente coperto dai media" e che Holeman è stato condannato a 21 anni di carcere.

Holeman ha deciso di intraprendere un'azione legale contro OpenAI e il gruppo di difesa dei diritti della privacy Noyb lo sta sostenendo per far valere le sue ragioni. Il gruppo ha affermato che, sebbene l'affermazione fatta dall'assistente AI sia completamente falsa, essa menziona accuratamente la città natale di Holeman e che ha tre figli. Noyb ha anche cercato di indagare sul motivo per cui è stata generata una tale risposta, ma non è riuscito a individuare una ragione.

ChatGPT include una clausola di esclusione di responsabilità che il chatbot può sbagliare e che gli utenti dovrebbero controllare le informazioni importanti, ma Noyb afferma che questo non solleva l'azienda dalla responsabilità, perché ha ancora il dovere, ai sensi del Regolamento generale sulla protezione dei dati (GDPR) dell'Unione Europea, di non produrre falsità eclatanti in primo luogo.

Fonte(i)

I nostri Top 10

» Top 10 Portatili Multimedia

» Top 10 Portatili Gaming

» Top 10 Portatili Gaming Leggeri

» Top 10 Portatili da Ufficio e Business economici

» Top 10 Portatili Premium da Ufficio/Business

» Top 10 Portatili sotto i 300 Euro

» Top 10 Portatili sotto i 500 Euro

» Top 10 dei Portatili Workstation

» Top 10 Subnotebooks

» Top 10 Ultrabooks

» Top 10 Convertibili

» Top 10 Tablets

» Top 10 Tablets Windows

» Top 10 Smartphones